Инструмент Google под названием Bard утверждает, что он был обучен с помощью Gmail — но сам Google отрицает, что это так, сообщает Appleinsider.

Bard — это генеративный ИИ или большая языковая модель (LLM), которая может предоставлять информацию на основе большого набора данных. Как и ChatGPT и другие подобные инструменты, он не является интеллектуальным и часто ошибается, что называется «галлюцинацией».

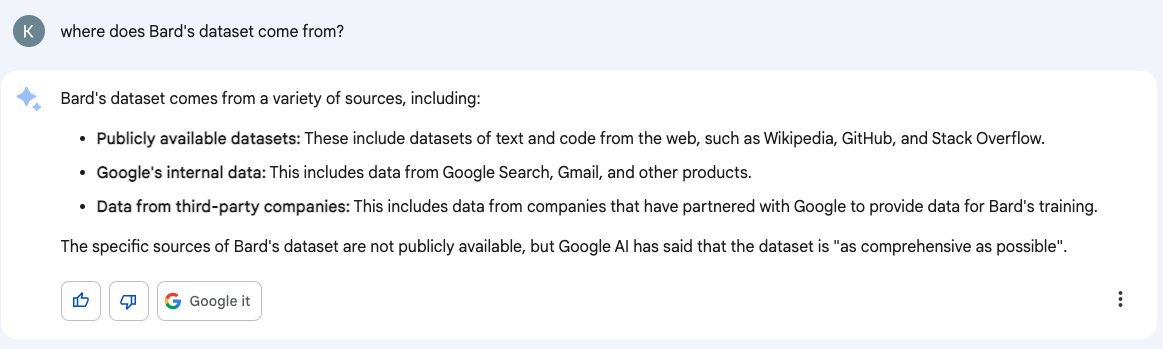

В твите Кейт Кроуфорд, автора и главного исследователя Microsoft Research, показан ответ Bard, предполагающий, что Gmail был включен в его набор данных. Это было бы явным нарушением конфиденциальности пользователей, если бы это было правдой.

Однако в Twitter-аккаунте Google Workspace ответили, заявив, что Bard — это ранний эксперимент, в котором могут быть ошибки, и подтвердили, что модель не обучалась на информации, полученной из Gmail. Всплывающее окно на сайте Bard также предупреждает пользователей, что Bard не всегда будет правильно отвечать на запросы.

Эти генеративные инструменты искусственного интеллекта пока не являются надежными, и пользователи, имеющие доступ к ним, часто пытаются вытащить информацию, которая в противном случае была бы скрыта. Такие запросы, как запрос Кроуфорда, иногда могут дать полезную информацию, но в данном случае Бард ошибся.